上報 Up Media

toggle- 最新消息 全球最強護照排名出爐 台灣免簽減4剩141國、排名不降反升至34名 2024-11-22 19:27

- 最新消息 江振誠攜手SSAW 進擊高雄極致餐飲市場 2024-11-22 19:00

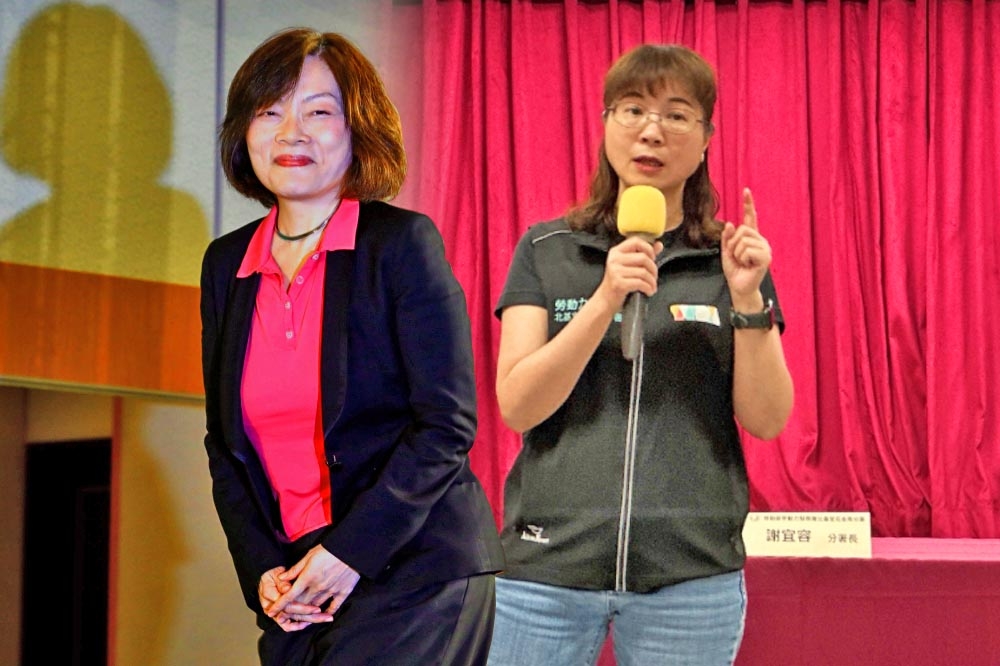

- 最新消息 勞動部即日起停職謝宜容 移送監察院、新北地檢署偵辦 2024-11-22 19:00

- 最新消息 【有片】全球彈道飛彈發射實時掌握 路透曝美國預警偵蒐能力有多強 2024-11-22 18:48

- 最新消息 亞歆海洋攜亞果推動遊艇休閒產業 遊艇交船典禮今登場 2024-11-22 18:30

- 最新消息 謝宜容影片「4大疑點」曝光 拍攝時間竟比賴清德二度道歉還晚 2024-11-22 18:25

- 最新消息 勞發署輕生公務員用輪椅送醫遭質疑 新北消防局說明原因 2024-11-22 18:20

- 最新消息 銀髮幸福再升級 「2024樂。無齡博覽會」高雄登場 2024-11-22 18:00

- 最新消息 2024《讚讚盃》12月火熱開打,即日起開放全台《傳說對決》電競好手報名 2024-11-22 18:00

- 最新消息 網友出征謝宜容娘家醬油廠 受波及業者喊話:勿成另一個霸凌者 2024-11-22 18:00

已有資料證實,ChatGPT會捏造文章或報導。(美聯社)

人工智慧(AI)聊天機器人「ChatGPT」在短短3個月,用戶便以每月1億人的速度激增,創下紀錄。在ChatGPT爆紅的同時,英國「衛報」意外發現ChatGPT會憑空杜撰新聞報導。衛報正針對這項問題,組成專業團隊,將在近期公布衛報使用這類AI程式的標準,以堅守新聞道德操守,並對旗下發布的文章負責。

衛報(The Guardian)編輯創新負責人莫蘭6日撰文表示,旗下記者上個月收到一封電子郵件,一名研究人員在信中提及一篇衛報記者幾年前就特定主題撰寫的文章,但在衛報網站及各大搜尋引擎都未找到這篇文章,令編輯部懷疑是否這篇報導在刊出後更改過標題,或發現某個問題而從網站下架,還是有人透過法律途徑將其強制撤稿。

At the @guardian we've been quite quiet about generative AI. It's mainly because we're treating a complex topic with the care it requires. Here's my piece on journalism, responsibility and why, in some crucial respects, nothing has changed https://t.co/pRjK1RhRmq

— Chris Moran (@chrismoranuk) April 6, 2023

這位記者不記得自己寫過這篇文章,但標題看起來的確像是衛報記者會寫的東西。由於擔心報社系統出現問題,莫蘭要求同事在系統中找出這篇文章;然而,在嘗試過所有辦法之後,就是遍尋不著這篇文章,原因在於「從來就沒有人寫過這篇報導」。

致函的研究人員告訴衛報,他們使用ChatGPT進行研究。莫蘭認為,是ChatGPT在被問及特定主題的報導時,編造了部分內容。ChatGPT的流暢性及其建立的大量訓練數據,意味著即使從未寫過這篇報導的「作者」,也可能相信這篇虛構文章的存在,「或許他曾經寫過」。

莫蘭指出,目前已有大量發現,生成式人工智慧(Generative AI)具有捏造事實與事件的傾向,這種「發明消息來源」的特殊問題,尤其讓值得信賴的新聞機構及記者感到不安,因為這些虛構文章若署名某些機構或記者,將大大增添它們的說服力與正當性。

For all the hype around ChatGPT, I can add my voice to those who have pointed out that it just makes things up.

— Marc Blank-Settle (@MarcSettle) April 6, 2023

The false info is plausible, but made up nevertheless.

I’ve never written a book on smartphone photography or an article for the Guardian - but ChatGPT insists I have. pic.twitter.com/NQN6qn0aoS

他說,對於讀者及更廣泛的訊息生態系統而言,ChatGPT提出了能否全然信任引述內容的全新問題,同時也可能助長秘密刪除敏感文章的陰謀論;但其實這些文章本來就不存在。

莫蘭更警告說,ChatGPT去年11月甫推出時乏人問津,但到今年1月已經有每月1億個活躍用戶,而大受歡迎的中國短影音應用程式TikTok,花了9個月才達到相同的數據。微軟(Microsoft)、Google等科技公司後來也紛紛推出自己的聊天機器人,凸顯聊天機器人的爆紅會讓這些捏造問題並非只是個案。

莫蘭還提及,另一名學生在兩天前聯繫衛報的檔案團隊,詢問另一篇具名記者撰寫的文章,社方也未在系統中查到這篇文章,來源同樣來自ChatGPT。

他指出,人們很容易陷入生成式AI所提供的細節,因為它的不透明性。而負責任的新聞機構所面臨的問題則是既簡單又緊迫:這項技術現在能做什麼?當廣泛的訊息生態系統已經受到錯誤訊息的誤導,如何使用ChatGPT來撰寫負責任的報導?

莫蘭聲稱,這正是衛報目前致力解決的問題,報社已籌組小型工程團隊,專注於技術學習、考慮公共政策及智慧財產權問題、聽取學者及從業人員的意見、與同業討論、諮詢並培訓員工,安全且負責任地探索這項技術,能夠如何應用在新聞報導上。

衛報近期將發布說明,敘述衛報未來將如何使用生成式AI,以堅守最高的新聞標準,為報社發布的新聞向讀者及世界負責。

熱門影音

熱門新聞

- 【懶人包】勞動部公務員疑遭職場霸凌輕生 事件始末「時間軸、手段、調查結果」一次看懂

- 起底謝宜容!傳身家背景雄厚「善做公關」 先生和綠營高層有交情

- 一元特典!YOASOBI「超現實」小巨蛋演唱會釋出「零星票券」,11/24 採實名制一般販售

- 【世界棒球12強賽】滿足「2條件」台灣確定晉級4強 今晚是關鍵

- 先搶先贏!Ado 五月林口體育館演唱會採實名制入場,11/19 輸入「指定代碼」可優先預購

- 陳妍希與陳曉鬧婚變疑復合 她素顏與閨蜜聚餐模樣超清純全網夢回《那些年》

- 【內幕】T112步槍裝彈器採購案疑專利侵權 以色列向軍備局寄存證信函

- 楊冪人氣暴跌與《慶餘年》張若昀演新片淪鑲邊女主 造型曝光全網夢回《三生三世十里桃花》