上報 Up Media

toggle- 最新消息 被緊咬是柯文哲分身 李文宗:大家都知道是蔡壁如 2025-01-02 22:12

- 最新消息 諷檢方下不了台「要關我就明講」 柯文哲:再加保就要賣房了 2025-01-02 22:00

- 最新消息 WSJ:中國已非美企「金礦」 難再幫北京說情 2025-01-02 21:50

- 最新消息 強烈冷氣團下周報到 低溫恐跌破10度、高山有望降雪 2025-01-02 21:34

- 最新消息 檢控他「恐逃亡海外」 沈慶京坐輪椅服藥:快80歲了怎麼跑 2025-01-02 21:08

- 最新消息 【盤點詐領助理費民代】高虹安成首位被判刑立委 女議長貪1300萬遭重判12年 2025-01-02 20:51

- 最新消息 中國股市2025開年不利 主要指數跳水近3%八年來最慘 2025-01-02 20:31

- 最新消息 柯文哲開庭遲到2小時原因曝光 「柯爸陷入昏迷」急赴醫院探視 2025-01-02 20:13

- 最新消息 扯!高科大考卷全是簡體字、教授名片竟印「中國台灣」 教育部出手了 2025-01-02 19:45

- 最新消息 賴清德拋「小兩會」協商兩岸觀光 陸委會提3大談判重點 2025-01-02 19:35

以色列在加薩的戰爭中,許多目標的打擊決策係由AI所做出。圖為本月4日被轟炸後的加薩代爾拜萊赫。(美聯社)

《華盛頓郵報》報導,去年10月爆發的以哈戰爭,堪稱是人類首次「AI戰爭」,以色列大量使用AI(人工智慧)技術在戰場上,被認為是小國反制大國威脅的利器,但其演算結論的價值,以及現實戰爭的後果,甚至防範未然的能力,目前仍存有巨大疑慮。

報導引述多方消息來源,指以色列推動AI應用已有長達十幾年的歷史,2020年時,沙利葉(Yossi Sariel)接掌以軍著名情報部隊、隸屬於軍事情報局的「8200部隊」(Unit 8200)後,其對AI的追捧程度更被一些內部人士形容成「宗教性」的,將重視個人推演,語言分析的文化,轉變為重視資料發掘、技術維護的工程師文化。

沙利葉執掌下的8200部隊開發出名為「福音」(Gospel)的AI軟體,專門蒐集大量加薩的數據,例如被截獲的通訊內容、衛星圖像、社群平台等,以更快的速度分析、彙整、歸納這些資訊,例如過去以軍要耗費1周的時間,才能在衛星圖像中微小的變化,發現哈瑪斯埋藏的火箭砲發射器或是挖掘的新地道,但是在「福音」的輔助下,30分鐘就可以完成,而以軍情報人員過去每年可在加薩找出50個新目標,AI則是每天可以找出100個,速度形同快了1000倍。

另一個被稱為「薰衣草」(Lavender)的AI系統,則可以彙整特定人物的通訊資料,加入的社群平台群組,是否頻繁更換地址,哈瑪斯文件提及的人名等,分析此人是哈瑪斯成員的機率。

以哈戰爭爆發的前1個月,AI系統就識別1.2萬個打擊目標,這在過去是耗時費力且須動用許多人員才能完成的工作,但問題也慢慢浮現,最受矚目的就是不可接受的平民死亡率,以軍過去可接受的平民死亡率,是在犧牲1名平民的情況下擊斃1名高層恐怖分子,但是在以哈戰爭中,每擊斃1名基層恐怖分子就會犧牲掉15名平民,高層恐怖分子甚至會犧牲掉超過20名平民。

高平民死亡率也讓AI的情報分析品質受質疑,還有對減少人員參與分析的疑慮,例如以軍內部審核曾發現,相較於語言分析的情報人員,AI軟體目前無法有效區別阿拉伯語的俚語及暗語,還有相較於過去以軍在轟炸特定目標時,會透過打電話等方式驅散平民,效率較差,但現在為求高效率,僅簡單的透過AI分析目標建築的訊號等資訊就直接轟炸,這沒有考慮到很多兒童並沒有手機。

甚至有以軍高層認為,過度重視AI技術發展,反而讓以色列對哈瑪斯去年10月發動攻擊措手不及,忽視先前的警告,而越級上報緊急事態,正是「8200部隊」過去的文化之一;1名前指揮官就說,以色列的國安情報部門宛如已成為「AI」工廠。

「AI戰爭」的缺陷及血腥後果逐漸凸顯出來,迫使以軍也在檢討過度仰賴AI的問題,但同時AI也被不少人認為是小國面對強敵時的重要利器;前以軍法務人員米姆朗(Tal Mimran)表示,他依然認為歐美必須擁抱AI,才能應對像中國這樣的對手,但是要小心AI在戰爭的高壓迷霧中做出的決策的準確性,「就速度而言,它改變了規則,但就品質來看,可能就不是如此了」。

熱門影音

熱門新聞

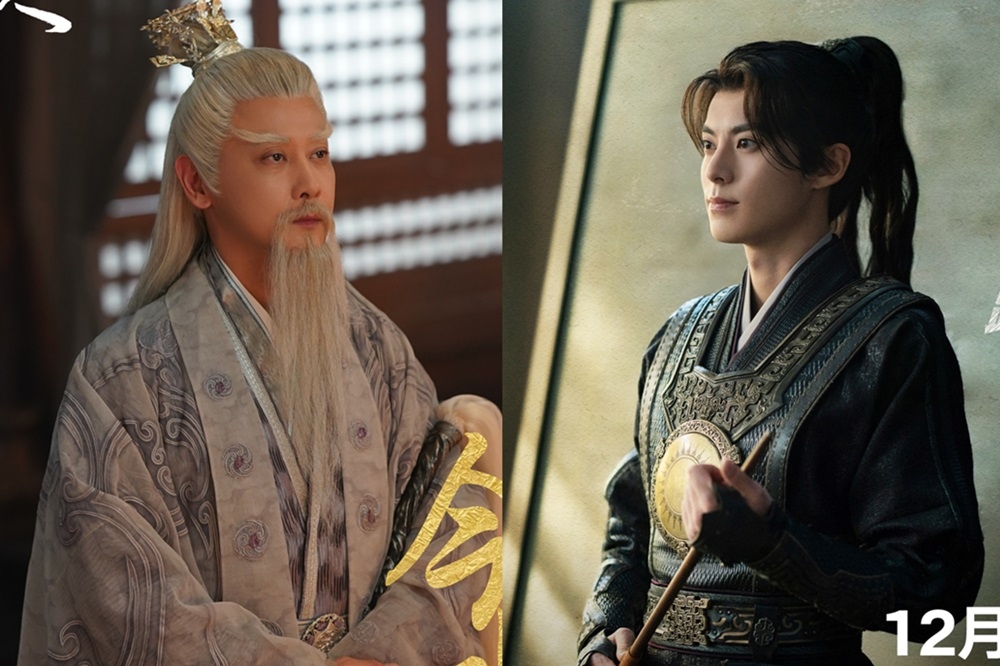

- 《大奉打更人》王鶴棣演技太爛被群嘲 來自台灣的「他」一人演活2角色佳評如潮

- 趙露思患失語症前傳訊好友「救救我」內容曝光 業界人士分析她已有這2種最壞打算

- 《珠簾玉幕》趙露思得失語症內幕曝光 她合約將到期還被逼搭檔《長相思》鄧為拍新劇

- 獨家/蔡阿嘎帶警方登門!蘿拉家中意外遭搜出喪屍菸彈 發聲明:不會卸責

- 趙露思慘遭毆打得憂鬱症原兇直指「她」 網揭《蒼蘭訣》李一桐、張凌赫也是受害者

- 《九重紫》孟子義住北京豪宅富家千金身份曝光 媽媽曝女婿3條件「李昀銳都有」全網嗑翻

- 王鶴棣《大奉打更人》首播熱度慘輸李昀銳《九重紫》 他演技3敗筆被嘲「像憤怒鳥在演戲」

- 趙露思曾因「這件事」慘遭經紀公司老闆辱罵賞巴掌 好友曝這成為她患失語症關鍵